论文分享 | 个性化内容生成

点击蓝字

关注我们

作者:许艺龑

单位:中国科学技术大学硕士二年级

研究方向:生成式推荐,个性化内容生成

TLDR

随着生成式人工智能技术的蓬勃发展,目前用户能够根据自身明确的需求生成各种高质量的内容,如文本、图像和音频等。然而,现实中多数用户通常并不清楚自身意图,于是个性化内容生成技术应运而生。它是一种主动的内容生成技术,旨在挖掘用户喜好并利用生成式AI为用户提供更加个性化的内容和服务,满足用户多样的隐式需求。将个性化内容生成技术与传统推荐系统结合起来,将构建起全新的推荐范式——生成式推荐系统,这不仅能够满足用户日益增长的个性化需求,还能够提高推荐系统的性能与用户体验。在人工智能生成内容(AI-Generated Content, AIGC)时代,个性化内容生成将成为推荐系统发展的重要趋势之一,在时尚、广告、书籍、视频等领域都将有着广泛的应用前景。例如,近期Sam Altman在斯坦福大学的闭门分享中提到,“Sora会实现全新的娱乐方式,每次看都会不同,会根据你的喜好、互动实时生成,介于电影和游戏之间。”通过持续的创新和技术进步,我们可以期待看到更智能化、更贴近用户需求的生成式推荐系统的出现,为用户带来更加丰富多样的个性化内容体验。本文旨在对当前个性化内容生成方向的一些工作进行梳理。

Generative Recommendation: Towards Next-generation Recommender Paradigm

Wenjie Wang, Xinyu Lin, Fuli Feng, Xiangnan He, Tat-Seng Chua

论文摘要

推荐系统通常从item库中检索items以进行个性化推荐,然而这种基于检索的推荐范式面临两个限制:1)人工生成的items可能无法满足用户多样化的信息需求,2)用户通常通过点击等被动且低效的反馈来调整推荐。如今,AIGC已经在各个领域取得了显著的成功,其具有克服这些限制的潜力:1)生成式人工智能可以生成个性化items,以满足用户特定的信息需求,2)新兴的大语言模型具备强大的语言理解和生成能力,为用户提供了另一种通过自然语言指令以更准确地表达信息需求的可能。在这种情况下,AIGC的蓬勃发展启发了下一代推荐系统的两个新目标:1)利用生成式AI生成个性化内容;2)集成用户指令以指导内容生成过程。

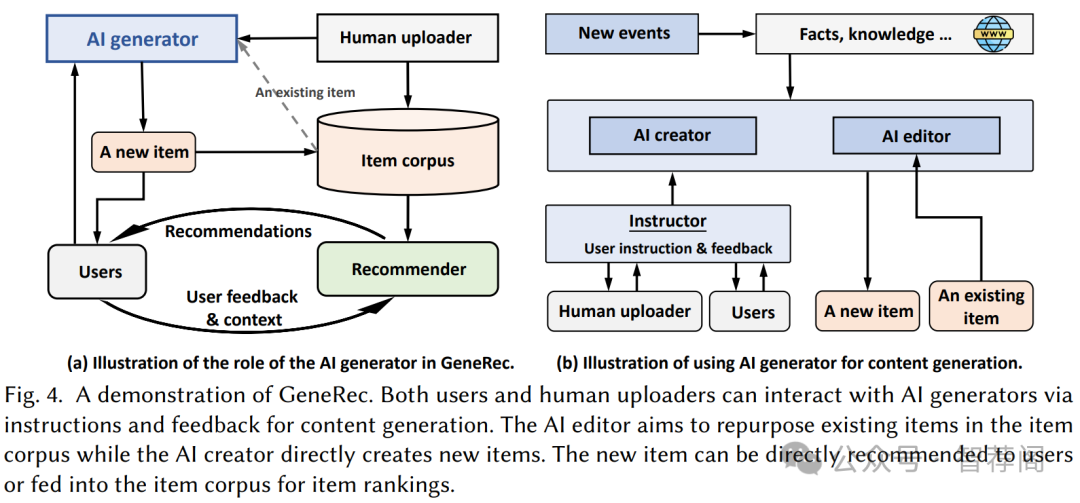

基于以上背景,我们提出了一种名为GeneRec的新型生成式推荐范式,其采用AI generator生成个性化内容,并通过用户指令获取其信息需求。具体而言,我们通过instructor对用户指令与传统反馈(如点击)进行预处理,以指导生成过程。在指导下,我们通过AI editor和AI creator来实现AI generator的实例化,分别用于现有items的编辑和新items的生成。最终,GeneRec可以融合内容检索、编辑和生成功能,以满足用户的信息需求。为确保生成items的可信度,我们强调各种保真度检查,例如真实性和合法性检查。除此之外,我们提供了一个GeneRec未来发展的路线图,并探讨了GeneRec在几个特定领域的应用以及一些潜在的研究任务。最后,我们研究了在短视频的生成推荐中实现AI editor和AI creator的可行性,并展现了不错的结果。

内容概述

这篇工作提出一种新型生成式推荐范式,赋予传统推荐系统以内容生成和指令引导的能力,该范式可以通过用户指令与反馈获取其信息需求,并基于此实现items的个性化检索、编辑和生成。具体而言,在传统的检索-用户系统循环中,人类,包括领域专家(例如音乐家)和普通用户(例如短视频用户),生成和上传items到数据库。推荐系统根据用户偏好对items进行排名,其中偏好是从历史推荐的上下文(例如交互时间)和用户反馈中学习的。为了补充这种传统范式,GeneRec在AI generator和用户之间添加了另一个循环,用户可以通过用户指令和反馈来控制AI generator生成内容,以满足个性化需求。此外,该工作也为未来的工作留下了许多有价值的研究方向:1) 如何从用户的多模态指令和反馈中获取有效的用户信息;2) 为各种任务开发更加强大的AI generator;3) 设计新的指标、标准和技术以丰富AIGC的评估和保真度检查。

Diffusion Models for Generative Outfit Recommendation

Yiyan Xu, Wenjie Wang, Fuli Feng, Yunshan Ma, Jizhi Zhang, Xiangnan He

论文摘要

时尚领域的穿搭推荐经历了两个演化阶段:预定义穿搭推荐和个性化穿搭组合。然而,这两个阶段都受限于已有的时尚单品,难以满足用户多样的时尚需求。如今,人工智能生成内容(AIGC)的出现为穿搭推荐提供了克服这些限制的机会,展示了个性化服装生成与推荐的潜力。

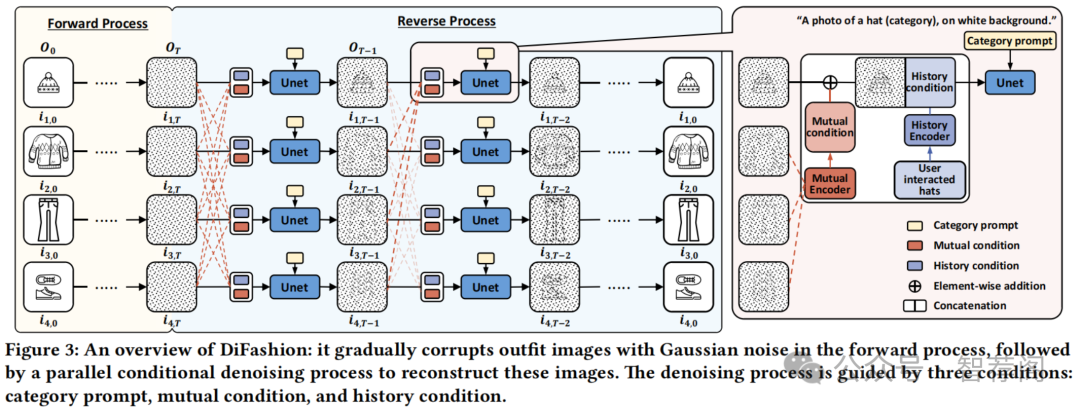

基于上述背景,我们引入了一项名为生成式穿搭推荐的新任务,其旨在生成一组时尚单品图像,并将它们组合成为用户量身定制的一套视觉上兼容的穿搭。该任务的主要目标在于确保生成穿搭的高保真度、兼容性和个性化。为了实现这些目标,我们提出了一种名为DiFashion的生成式穿搭推荐模型,该模型基于扩散模型构建,能够实现多张时尚单品图像的并行生成。为了保证这三个目标,我们设计了三种条件来指导并行生成过程,并采用无分类器引导(Classifier-Free Guidance)来增强生成图像与各个条件间的一致性。我们将DiFashion应用于个性化填空任务(Personalized Fill-In-The-Blank)以及生成式穿搭推荐任务上,在iFashion和Polyvore-U两个数据集上进行了广泛的实验。定量评估和人为参与的定性评估均证明了DiFashion的优越性。

内容概述

这篇工作关注个性化内容生成在时尚领域中的应用,提出了一个全新的任务——生成式穿搭推荐。该任务的核心在于根据用户交互历史并行生成多张个性化的时尚单品图像,并将其组合为一套协调的穿搭推荐给用户。这些生成图像可通过在数据库中进行检索或与时尚制造商合作进行定制,从而实现实际应用。为实现这一目标,该工作基于扩散模型构建专用于该任务的模型DiFashion,该模型以一整套穿搭为单位,在前向过程中对各个时尚单品图像进行并行独立的加噪过程,当噪声足够大时,图像将近似于纯噪声;而在反向过程中,逐步重构出原始的图像内容。在反向的生成过程中,DiFashion引入了三个条件来指导生成过程:类别信息(category prompt)、兼容性信息(mutual condition)与个性化信息(history condition)。其中,类别信息通过文本的形式进行传递,兼容性信息由同一套穿搭内其余单品经过编码器Mutual encoder提取,个性化信息则由用户历史交互过的单品经过编码器History encoder提取。这三个条件协同指导反向过程中多张图像的并行生成过程。此外,DiFashion采用无分类器引导策略以确保生成图像与各条件间的一致性。这项工作首次提出生成式穿搭推荐任务及相应模型,有助于打造更加个性化的时尚体验。

PMG : Personalized Multimodal Generation with Large Language Models

Xiaoteng Shen, Rui Zhang, Xiaoyan Zhao, Jieming Zhu, Xi Xiao

论文摘要

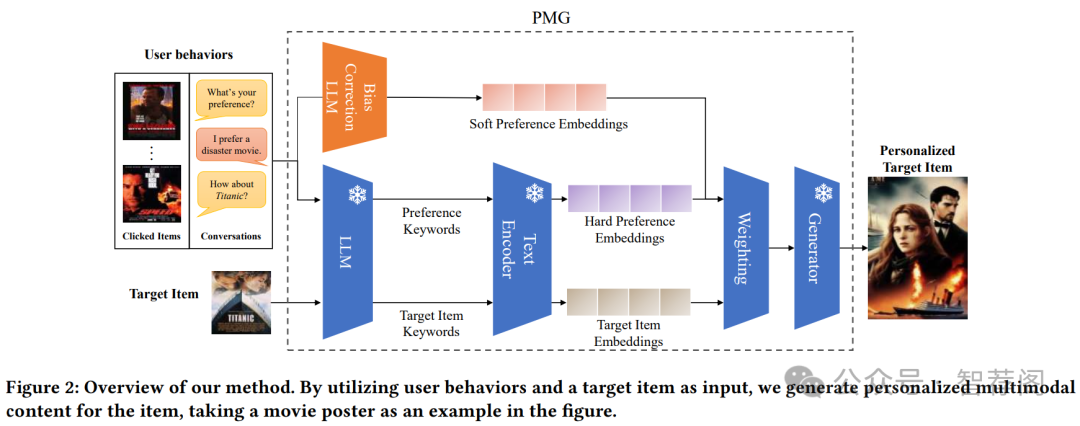

大语言模型的出现彻底改变了文本理解和生成的能力。多模态生成引起了工业界和学术界的极大关注,但在个性化生成方面的研究还很少,而这在推荐系统中有着重要的应用。本文首次提出了利用大模型完成个性化多模态生成的方法,展示了其应用并在两个数据集上进行了广泛的实验以验证其性能。该方法名为个性化多模态生成(Personalized Multimodal Generation, PMG),它首先将用户行为(如推荐系统中的点击行为或与虚拟助手的对话)转换为自然语言,以便大语言模型理解并提取用户偏好描述。随后,这些用户偏好被输入到生成器中,如多模态大模型或扩散模型,用以生成个性化内容。为了全面且准确地捕捉用户偏好,我们提出利用大语言模型输出一组显式的关键词和隐式的表示来表征用户偏好,将这二者组合为提示来指导生成器的生成过程。我们优化了准确性和偏好分数的加权和,以确保生成内容在准确性与个性化之间保持良好的平衡。与没有考虑个性化信息的基准方法比较,PMG在保障生成内容准确性的同时,在个性化指标LPIPS上实现了高达8%的提升。

内容概述

这篇工作提出了一种名为PMG的方法,旨在利用大语言模型完成个性化多模态生成任务。该方法聚焦于利用大语言模型从用户的历史交互和对话中提取用户偏好,以指导内容生成过程。具体地,PMG首先将用户交互历史和对话处理为自然语言形式,随后利用大语言模型分别提取用户偏好关键词和目标item的关键词。鉴于偏好关键词可能存在表达能力不足的问题,PMG提出微调大语言模型(Bias Correction LLM)以提取隐式的用户偏好表示,该表示与前述关键词通过加权和的形式结合,共同指导内容生成过程,从而实现对目标item的个性化编辑。PMG在三个不同场景(时尚图像、电影海报、表情)中开展实验,实验结果证实了该方法的可行性和有效性。

A New Creative Generation Pipeline for Click-Through Rate with Stable Diffusion Model

Hao Yang, Jianxin Yuan, Shuai Yang, Linhe Xu, Shuo Yuan, Yifan Zeng

论文摘要

在线广告场景中,卖家通常需要创建多个广告创意来全面展示产品或服务,因此,展示最具吸引力的广告设计以最大化点击率(Click-Through Rate, CTR)变得尤为关键。然而,卖家往往难以准确把握用户对广告创意的偏好,这导致他们在审美水平和创意数量上难以与基于人工智能的方法相媲美。传统的基于AI的方法在这一点上也存在挑战,因为它们不考虑用户信息,同时设计师的审美知识有限。实际上,融合用户信息生成的广告创意可能更具吸引力,因为不同的用户可能有不同的偏好。为了提高广告点击率,传统方法通常使用创意排名模型对多个广告创意进行排序,该模型能够根据用户特征预测每个广告创意的点击率分数。然而,这两个阶段(创意生成和排序)通常被视为独立的任务分别进行优化。具体而言,在创意生成阶段,如果不考虑点击率的提升,可能会生成质量较低的创意,从而影响广告效果。

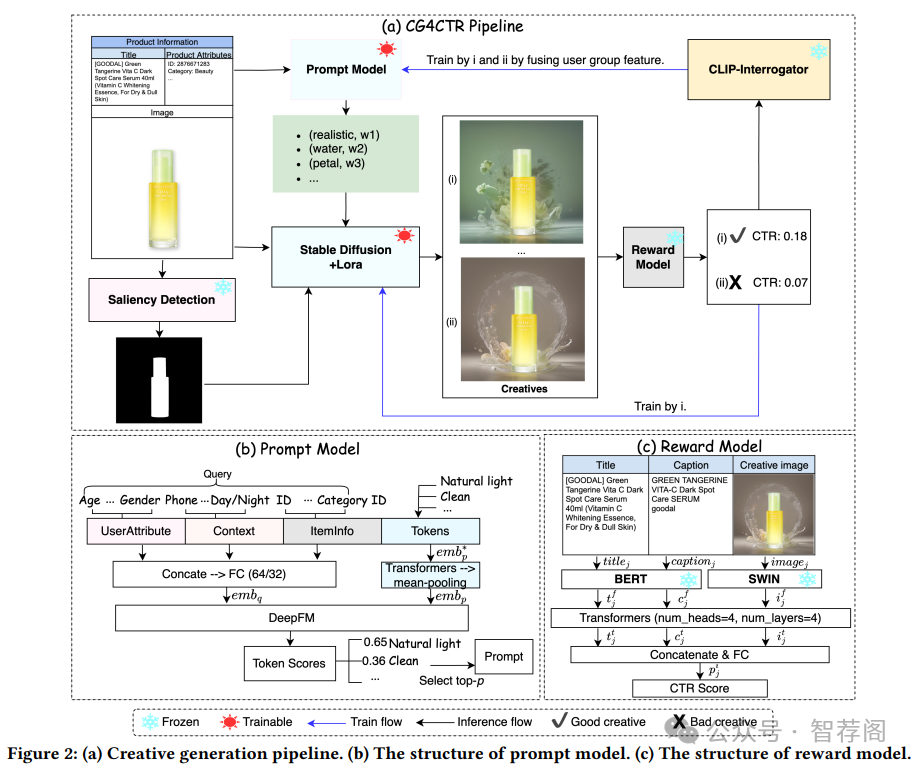

在这篇文章中,我们提出了一个全新的自动化创意生成pipeline,名为CG4CTR,旨在提升创意生成阶段的点击率。该pipeline基于提示模型和奖励模型,通过Stable Diffusion with LoRA自动生成和选择新的创意。本文的贡献分为四个方面:1)我们首次将Stable Diffusion的图像修复模式应用于在线广告场景中的创意图像生成任务,提出了一种自循环的创意生成pipeline以保证训练的收敛性;2)我们的提示模型旨在为不同的用户群体生成个性化的创意广告提示,从而进一步提高生成创意的多样性和质量;3)奖励模型综合考虑图像和文本的多模态特征,以提升创意排名任务的效果,在自循环的创意生成pipeline中也起到至关重要的作用;4)在线和离线实验中获得的显著效益验证了所提方法的重要性。

内容概述

这篇工作提出了一种名为CG4CTR的新型创意生成pipeline,将点击率目标融合到创意生成任务中。具体而言,该pipeline由三个关键部分组成:1)提示模型(Prompt Model)基于用户属性、目标物品属性及上下文特征,筛选出多个合适的词语或token,组合为个性化提示以指导创意广告生成过程;2)Stable Diffusion基于个性化提示和目标物品的掩码,为目标物品生成个性化广告(背景);3)奖励模型(Reward Model)基于目标物品信息对个性化广告进行评分。CG4CTR采用一种自循环的训练机制,在训练过程中筛选出当前点击率分数更高的个性化广告作为下一轮的训练数据,以更新提示模型和Stable Diffusion的LoRA模块。这种机制确保了模型在训练过程中不断优化,提高生成的个性化广告的质量和点击率。

Character-based Outfit Generation with Vision-augmented Style Extraction via LLMs

Najmeh Forouzandehmehr, Yijie Cao, Nikhil Thakurdesai, Ramin Giahi, Luyi Ma, Nima Farrokhsiar, Jianpeng Xu, Evren Korpeoglu, Kannan Achan

论文摘要

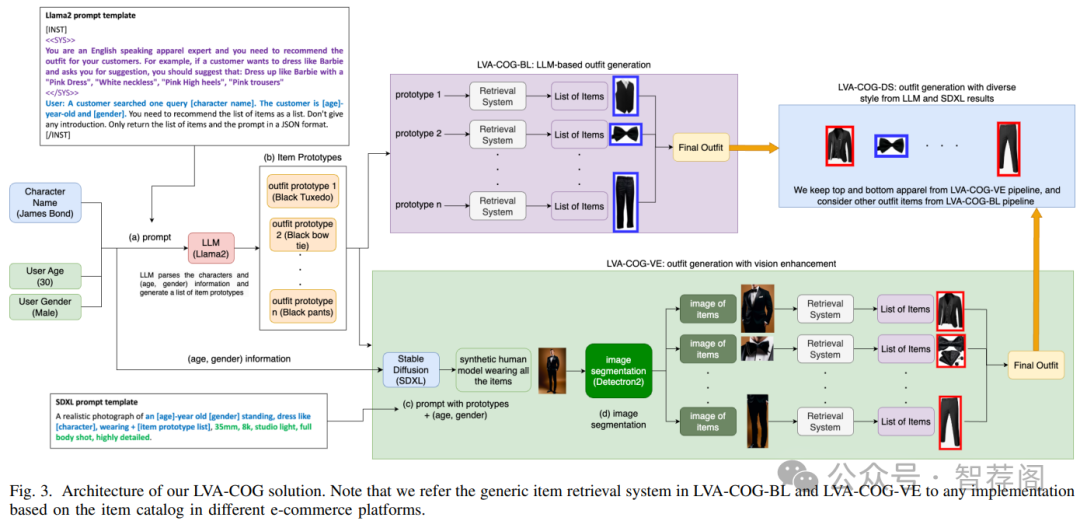

穿搭生成要求根据用户兴趣向其推荐一套完整的穿搭。现有方法侧重于根据目标单品或特定的用户查询进行推荐,但没有考虑用户对电影、社交媒体等中的著名角色的兴趣。在本文中,我们定义了一个全新的基于角色的穿搭生成问题,旨在准确解释角色信息,并根据用户属性生成完整的穿搭。为解决该问题,我们提出了名为LVA-COG的新框架,它利用大语言模型和提示工程技术来准确理解用户偏好。此外,我们利用text-to-image模型以增强视觉理解并生成和谐的穿搭。该框架将大语言模型和text-to-image模型集成在一起,并通过生成个性化推荐提升用户走进时尚的方式。通过实验和案例研究,我们从多个维度证明了该框架的有效性。

内容概述

这篇工作提出了一个新的穿搭生成任务,即基于角色的穿搭生成,并设计了相应的框架LVA-COG以完成该任务。该框架基于目标角色名和用户属性构建提示,利用大语言模型Llama2提取用户的时尚偏好,从而推断出与目标角色相关且用户偏好的单品原型(item prototypes)。在此基础上,将个性化单品原型与角色名、用户属性结合起来构建提示,以指导Stable Diffusion生成一张完整的穿搭图像。随后,LVA-COG通过图像分割技术提取出各个单品图像用于检索,最终得到与目标角色相关的个性化穿搭。这一框架的创新性在于利用将大语言模型捕捉用户时尚偏好,同时确保了穿搭的兼容性,该方法为时尚穿搭生成任务提供了一种新的思路和解决方案。